هوش مصنوعی در برابر تهدیدات سایبری موثر عمل میکند

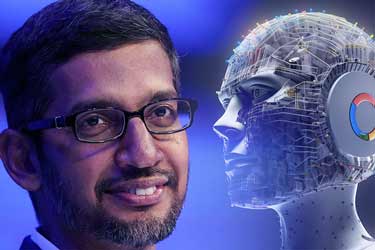

پیچای گفت: «در میان نگرانیهای فزاینده در مورد استفادههای شرورانه از هوش مصنوعی، ابزارهای اطلاعاتی میتوانند به دولتها و شرکتها در شناسایی و پاسخ به تهدیدات، به خرابکاران کمک کنند».

به گزارش ایتنا، امروزه حجم و پیچیدگی حملات سایبری افزایش یافته است چرا که خرابکاران به طور فزایندهای از آن به عنوان راهی برای اعمال قدرت و اخاذی استفاده میکنند. حملات سایبری در سال 2023 حدود 8 تریلیون دلار به اقتصاد جهانی خسارات وارد کرد – مبلغی که قرار است تا سال 2025 به 10.5 تریلیون دلار افزایش یابد.

پیچای بیان کرد که هوش مصنوعی زمان مورد نیاز برای شناسایی حملات و واکنش در برابر آنها را برای متخصصان امنیتی کاهش میدهد. او گفت:« این امر باعث کاهش معضل مدافعان میشود که به موجب آن، هکرهای سایبری باید فقط یک بار برای حمله به یک سیستم موفق باشند در حالی که صاحبان سیستمها باید هربار برای محافظت از آن موفق باشند.»

گوگل هفته گذشته، ابتکار جدیدی را اعلام کرد که ابزارهای هوش مصنوعی و سرمایه گذاریهای زیرساختی را برای تقویت امنیت آنلاین ارائه میدهد. این شرکت در بیانیهای گفت:« ابزاری رایگان و عمومی با نام Magika به کاربران کمک میکند بدافزارها را شناسایی کنند.»

پیچای گفت که این ابزارها قبلاً در محصولات این شرکت مانند گوگل کروم و جیمیل و همچنین سیستمهای داخلی آن استفاده میشدند.

هوش مصنوعی در یک تقاطع قرار دارد؛ جایی که سیاستگذاران، متخصصان امنیتی و جامعه مدنی این شانس را دارند که در نهایت، تعادل امنیت سایبری را از مهاجمان به مدافعان سایبری تغییر دهند.

این انتشار همزمان با امضای قراردادی توسط شرکتهای بزرگ در MSC برای اتخاذ “اقدامات احتیاطی معقول” برای جلوگیری از استفاده از ابزارهای هوش مصنوعی برای برهم زدن آرای دموکراتیک در سال انتخابات 2024 و پس از آن بود.

ادوبی، آمازون، گوگل، آیبیام، متا، مایکروسافت، اپنایآی، تیکتاک و ایکس از جمله امضاکنندگان این قرارداد بودند که شامل چارچوبی برای نحوه واکنش شرکتها به دیپفیکهای تولید شده توسط هوش مصنوعی است که برای فریب رأیدهندگان طراحی شدهاند.

هیلاری کلینتون، وزیر امور خارجه سابق آمریکا چندی پیش، فضای مجازی را «میدان جنگ جدید» توصیف کرد. او در مونیخ گفت: «مسابقه تسلیحاتی فناوری به تازگی با کمک هوش مصنوعی مولد، یک پله پیشرفتهتر شده است.»

گزارشی که هفته گذشته توسط مایکروسافت منتشر شد نشان داد که هکرهای مورد حمایت دولت از روسیه و چین از مدل زبان بزرگ (LLM) برای اهداف سیاسی خود استفاده میکنند. گفته میشود که اطلاعات نظامی روسیه و دولتهای چین و کره شمالی، همگی بر این ابزارها تکیه کردهاند.

مارک هیوز، رئیس بخش امنیت خدمات فناوری اطلاعات و شرکت مشاوره DXC Technology گفت:« هکرها به طور فزایندهای به ابزارهای الهام گرفته شده از ChatGPT به نام WormGPT برای انجام وظایفی مانند کد مهندسی معکوس متکی هستند. با این حال، ابزارهای مشابهی به مهندسان کمک میکند تا حملات را با سرعت شناسایی و مهار کنند. اگر بتوانید کمی سریعتر از حریف خود عمل کنید، موفقتر خواهید بود. این چیزی است که هوش مصنوعی به عنوان برگ برنده به متخصصان امنیت سایبری میدهد.»

این مطلب از سایت ایتنا گردآوری شده است.

منبع: ایتنا